链式思考(COT)

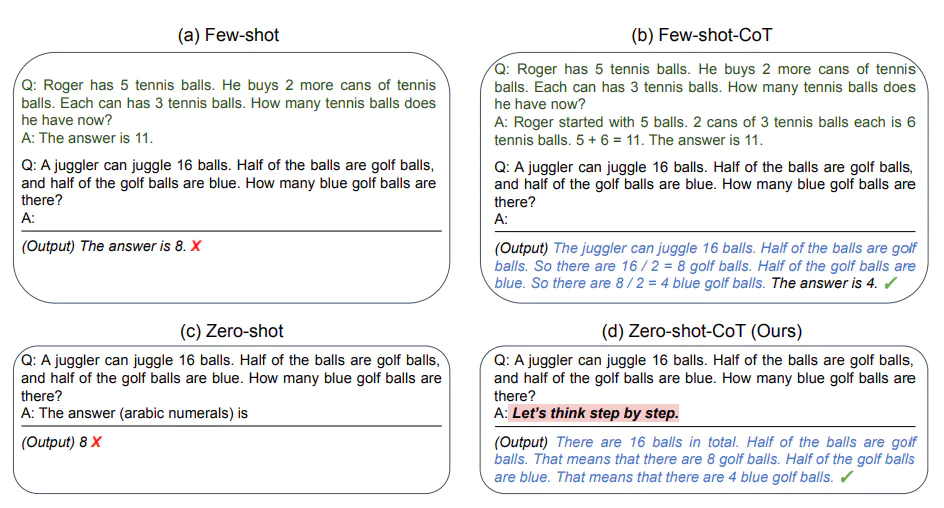

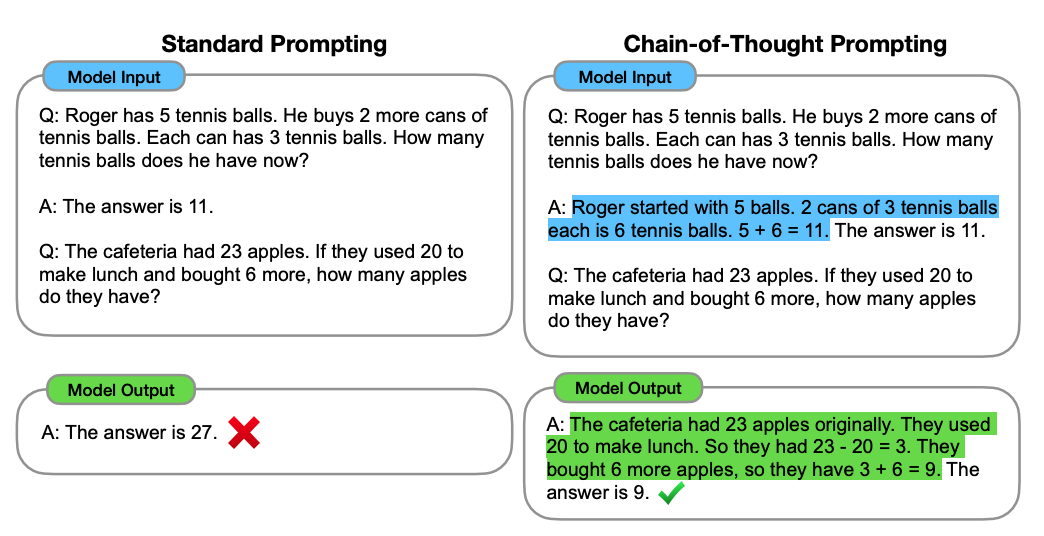

Chain of thought prompting 是一种简单且广泛适用的方法,可提高语言模型执行各种推理任务的能力。通过对算术和常识推理的实验,我们发现思维链式启发是模型规模的一种新兴属性。 在 Google 2023.01 的论文 Chain-of-Thought Prompting Elicits Reasoning in Large Language Models 中对于三个大型语言模型上的实验表明,思考链提示改善了一系列算术、常识和符号推理任务的性能。具体效果如下:  图1:思维链提示使得大型语言模型能够解决复杂的算术、常识和符号推理任务。思维链推理过程被突出显示。 从上图的例子中可以看到,本来在左侧提出问题,大语言模型算出来的答案是错误的,而当我们在 Prompt 中的例子里加入推导出答案的逻辑过程的文案后,大语言模型竟然神奇地能够给出正确答案。 这个给出逻辑推理过程示例就能让大语言模型能力提升的方法被称为 Chain of Thought Prompting。也就是我们可以在 Prompt 中提供推理步骤的示例后,得到大语言模型更好的结果。 例如提示可以是:零样本 COT Prompt

基于谷歌团队的研究成果,在另一篇 Large Language Models are Zero-Shot Reasoners 的论文中发现了 Prompt 的黄金语句,连一个案例都不用给它,即